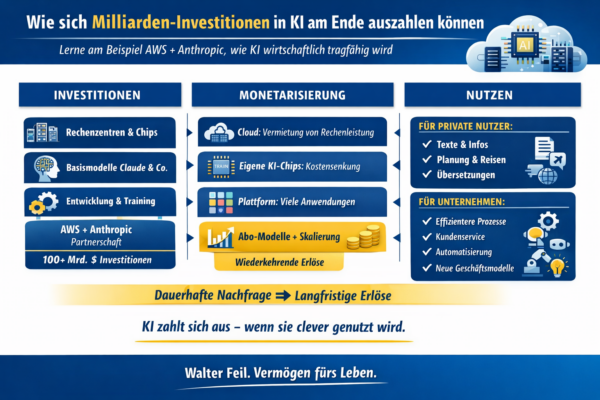

Fast jeden Tag erhalten wir neue Meldungen über gigantische Investitionen in KI-Rechenzentren und in die Entwicklung von KI-Anwendungen. Am Beispiel der am 20.6.26 bekanntgegebenen Zusammenarbeit zwischen AWS (Amazon Web Services) und Anthropic wird deutlich, wie durch das Zusammenwirken von Hardware (AWS-Rechenzentren) und Software (Anthropic KI-Modelle) Geld verdient werden kann.

100 Milliarden für die Trainium-Chips von AWS

Anthropic verpflichtete sich, in den kommenden zehn Jahren mehr als 100 Milliarden US-Dollar für Technologien von Amazon Web Services (AWS) auszugeben. „Diese Vereinbarung umfasst Trainium2, Trainium3, Trainium4 sowie die Möglichkeit, zukünftige Generationen von Trainium zu erwerben, sobald diese verfügbar sind“, erklärte Amazon in einer Pressemitteilung. Zudem fügte das Unternehmen hinzu, dass AWS-Kunden vollen Zugriff auf die native Claude-Konsole von Anthropic direkt innerhalb von AWS erhalten werden. Darüber hinaus kündigte Amazon an, jetzt 5 Milliarden US-Dollar in Anthropic zu investieren und künftig bis zu 20 Milliarden US-Dollar zusätzlich bereitzustellen – zusätzlich zu den bereits investierten 8 Milliarden US-Dollar in das KI-Unternehmen.

Hinter diesen Investitionen steht eine klare wirtschaftliche Logik. Amazon investiert Milliarden in den KI-Anbieter, während Anthropic im Gegenzug enorme Rechenleistung bei AWS nutzt. Daraus entsteht ein Kreislauf, in dem sich Investitionen Schritt für Schritt amortisieren können.

KI ist kein Produkt – sondern eine Infrastruktur

Der erste wichtige Punkt: KI ist kein einzelnes Produkt. Sie besteht aus mehreren Ebenen:

- Hardware (Rechenzentren, Chips, Stromversorgung)

- Basismodelle (z. B. Sprachmodelle wie ChatGPT und Claude)

- Anwendungen (z. B. Assistenten, Analyse-Tools)

- Integration in den Alltag von Unternehmen und Nutzern

Die wirtschaftliche Wirkung entsteht erst dann, wenn diese Ebenen zusammenspielen.

Die Hardware wird zur Einnahmequelle

Rechenzentren sind teuer. KI-Chips sind teuer. Energie ist teuer. Doch Unternehmen wie Amazon nutzen diese Infrastruktur nicht nur selbst – sie vermieten sie über die Cloud an tausende Kunden weltweit. Damit wird aus einer einmaligen Investition ein dauerhafter Einnahmestrom. Jede KI-Anfrage, jede Analyse, jedes Training eines Modells erzeugt Nachfrage nach Rechenleistung. Und genau diese Nachfrage wird abgerechnet.

Eigene Chips senken die Kosten

Ein entscheidender Hebel ist die Kontrolle über die Kosten. Mit eigenen Chips wie „Trainium“ versucht AWS, KI günstiger zu betreiben als mit klassischen Lösungen. Je niedriger die Kosten pro Anfrage, desto besser die Marge – oder desto attraktiver der Preis für Kunden. Das ist vergleichbar mit einem Energieversorger: Wer Strom günstiger erzeugt, kann entweder mehr verdienen oder Marktanteile gewinnen.

Ein Modell – viele Anwendungen

Ein großer Teil der Kosten entsteht beim Training von KI-Modellen. Doch sobald ein Modell entwickelt ist, kann es in vielen Bereichen gleichzeitig eingesetzt werden, zum Beispiel im Kundenservice, bei der Analyse von Dokumenten, bei der Programmierung, beim Wissensmanagement sowie im Marketing und im Vertrieb. Die hohen Entwicklungskosten verteilen sich damit auf viele Anwendungen. Das Modell wird zur Plattform. Vergleichen Sie dies mit der Plattform von Apple, die über viele Jahre hinweg aufgebaut wurde und die heute Milliarden verdient über den kostenpflichtigen Download von Apps.

Viele kleine Erlöse ergeben ein großes Geschäft

Die eigentliche Stärke des KI-Marktes liegt in der Skalierung. Ein einzelner Nutzer zahlt vielleicht nur 20 oder 30 Euro im Monat. Ein Unternehmen vielleicht einige tausend Euro. Doch wenn Millionen Nutzer und Unternehmen KI regelmäßig einsetzen, entstehen daraus stabile, wiederkehrende Umsätze. Genau das macht KI wirtschaftlich so interessant: eine Million mehr Nutzer verursachen nur noch geringe Kosten, wenn die Plattform erst einmal steht. Dann geht es nur noch um die Betriebskosten, vor Allem um die Energie.

KI spart nicht nur Kosten – sie schafft neue Erträge

Ein häufiger Denkfehler: KI wird nur als Kostenersparnis gesehen. Tatsächlich liegt der größere Hebel oft auf der Einnahmenseite. Unternehmen können mit KI schneller Angebote erstellen, mehr Kunden gleichzeitig betreuen und neue Dienstleistungen entwickeln. Das führt nicht nur zu Effizienz, sondern oft zu mehr Umsatz.

AWS und Anthropic – ein Beispiel für funktionierende Skalierung

Die Partnerschaft zwischen AWS (Amazon Web Services) und Anthropic zeigt dieses Modell in der Praxis:

- AWS stellt Infrastruktur und Chips bereit

- Anthropic entwickelt und betreibt KI-Modelle

- steigende Nutzung erzeugt steigende Nachfrage nach Rechenleistung

Beide Seiten profitieren voneinander. Man könnte es so formulieren: Die eine Seite baut die Autobahn – die andere sorgt für den Verkehr.

Die Logik hinter den Milliarden

Die Investitionen in KI wirken auf den ersten Blick gewaltig. Doch sie folgen einer klaren wirtschaftlichen Struktur:

- Infrastruktur wird aufgebaut

- Nutzung wird skaliert

- Kosten werden gesenkt

- Anwendungen werden verbreitet

- Erlöse entstehen wiederkehrend

Die Partnerschaft zwischen AWS und Anthropic zeigt, wie sich daraus ein System entwickelt, das langfristig tragfähig sein kann.

Schaubild erstellt mit freundlicher Unterstützung von ChatGPT

Die entscheidende Frage für Anleger und Unternehmer ist daher nicht, ob KI kommt – sondern wie sie genutzt wird. In der Strategie „Vermögen fürs Leben“ investieren wir bereits in diese Entwicklung, und dies im Rechtsrahmen einer Versicherung langfristig steuerfrei.

- IhrKonzept-KAPITALMARKTAUSBLICK: - 29. April 2026

- Wasserstoff: Zukunftsmarkt mit hoher Schwankung - 27. April 2026

- US-Steuervorteile als Turbo für den KI-Investitionsboom - 26. April 2026